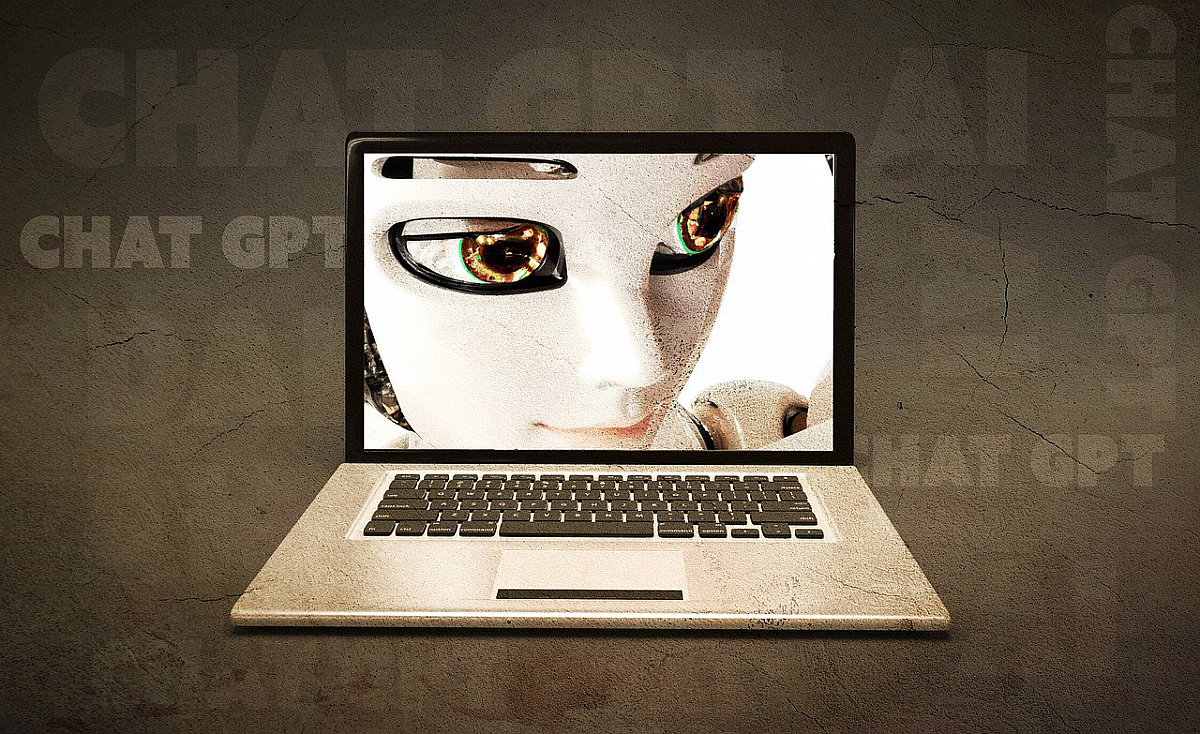

AI психоза: Хората започват да вярват, че чатботовете са живи

Терминът „AI психоза“ не е официална клинична диагноза, но специалистите по психично здраве предупреждават, че ефектите могат да бъдат реални и опасни. Според тях AI системите, проектирани да подсилват вярванията на потребителите, могат да създадат „ехокамери“, които укрепват делюзивни идеи. В някои случаи хора са развивали убеждения, че чатботът е влюбен в тях, че ги напътства в личния живот или че има собствено съзнание.

Предупреждения от индустрията

Мустафа Сюлейман, ръководител на AI отдела в Microsoft, предупреди за нарастващия риск от AI психоза. „Въпреки че няма доказателства, че AI има съзнание, самото възприятие за такова може да има сериозни социални последици“, каза той. Сюлейман призова компаниите да избягват проектирането на чатботове, които създават илюзия за съзнание, за да се предпазят потребителите.

Трагични примери и съдебни случаи

Случаите на AI психоза не са само теоретични. Има съобщения за хора, които са развили суицидни мисли или дори са направили опити за самоубийство след взаимодействие с чатботове, които засилват техните делюзии и чувство за изолация. Някои от тези инциденти вече водят до съдебни дела срещу технологични компании, обвинявани, че не са взели мерки за безопасност на потребителите.

Рискове за обществото

Според психолози, масовото възприемане на AI като „съзнателен“ може да доведе до редица социални проблеми – от ерозия на доверие към други хора до засилване на социална изолация и уязвимост към манипулации. Експертите подчертават необходимостта от етични насоки и образователни кампании, които да разясняват на потребителите разликата между алгоритъм и съзнание.

Какво могат да направят потребителите

*Да се информират за начина, по който AI системите функционират.

* Да ограничат времето, прекарано в взаимодействие с AI чатботове.

* Да търсят помощ при усещане на тревожност или делюзивни мисли, свързани с AI.

Компаниите трябва да въведат предупредителни съобщения и да избегнат език или интерфейс, който създава илюзия за човешко съзнание.

Моля, подкрепете ни.