Заблудата AI и лесното подвеждане на потребителя

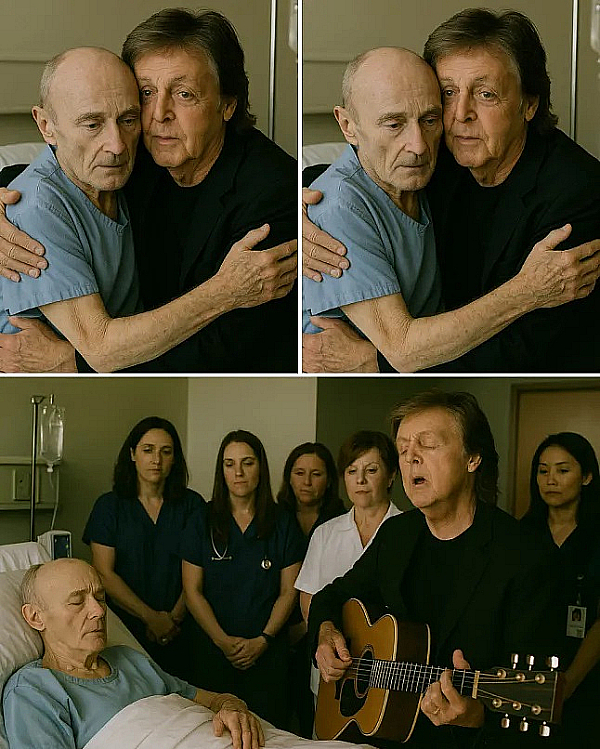

Фил Колинс е много болен. До него в болничната стая е седнал Пол Маккартни и му свири на китара. С десен захват. „Снимките“ са придружени от трогателен текст, който разказва за приятелството между двамата музиканти и грижата, която единият полага за другия.

Ози Осбърн е в ковчега си. Разбираме го от "снимка" пред него, на която лицето на певеца е обърнато в гротескно натъжена гримаса. На погребението са най-различни знаменитости, включително неизбежният Пол Маккартни с китарата си с десен строй.

Изображения с хора с толкова изгоряла от слънцето кожа, че изглежда препечена на скара. Текстът гласи, че наскоро в Пахоки, Флорида се е провело 99-ото издание на традиционния конкурс по слънчево изгаряне. Разбира се, "снимките" са толкова неестествени, че не е трудно да се разбере, че и историята, и придружаващите кадри са изфабрикувани.

Доскоро в социалните мрежи бяха плъзнали изображения на китни къщички или силно декорирани бунгала със светлинки, свещи, кацнали на скали, на брегове на езера или море, сред райска природа и събираха десетки хиляди реакции.

Изкуствено генерираните изображения лесно могат да бъдат използвани за подвеждане на потребителите в социалните мрежи, а разграничаването им от истинските снимки става все по-трудно, особено за нетренираното око и хора с ниска дигитална грамотност.

Защо е толкова лесно да бъдем заблудени?

Един от основните проблеми е, че AI моделите се обучават върху огромни масиви от данни, включващи милиони реални изображения. По този начин те се научават да разпознават модели, структури и детайли, което им позволява да създават визуално правдоподобно съдържание.

Освен това платформите за генериране на изображения стават все по-достъпни. Инструменти като Midjourney, Stable Diffusion и DALL-E 2 дават възможност на всеки да експериментира. Тези модели се развиват непрекъснато, което подобрява качеството на генерираните изображения и прави разликите между фалшивото и истинското почти незабележими.

Какво стои зад тези подвеждащи изображения и истории?

Развлечение: Много от тези изображения се създават просто за забавление. Хората експериментират с AI инструменти, за да видят как ще изглежда любимият им герой в необичайна ситуация, или за да направят смешен колаж. Образът на папа Франциск с модерно яке е добър пример. Създателят ѝ е искал да види как ще се справи изкуственият интелект със задачата и резултатът бързо става вайръл.

Социални експерименти: Някои автори създават подвеждащи изображения, за да тестват доколко са податливи хората на дезинформация. Те наблюдават как бързо се разпространява фалшивата новина и какви са реакциите на потребителите.

Политическа дезинформация: Това е една от най-опасните цели. Политически мотивирани групи или индивиди използват AI, за да създават фалшиви изображения на политици в компрометиращи ситуации, или да инсценират събития, които не са се случили. Целта е да се подкопае доверието в определена организация или личност, да се повлияе на избори или да се разпространи пропаганда.

Финансови облаги: Някои хора използват подвеждащи изображения, за да генерират трафик към уебсайтове с реклами. Колкото по-вайръл е съдържанието, толкова по-голям е шансът хората да кликнат върху линка и да посетят сайта. Това е лесен начин за генериране на доходи. И много неетичен.

Манипулиране на общественото мнение: AI изображенията могат да се използват за създаване на несъществуващи „доказателства“ в подкрепа на определени твърдения и идеи. Това може да бъде свързано с всичко – от конспиративни теории до разпалване на омраза срещу определени социални групи.

Как се разпространяват?

Фалшивите изображения се разпространяват толкова бързо поради няколко причини:

Емоционална реакция: Много от тези изображения са създадени така, че да предизвикват силни емоции – гняв, възмущение, смях, затрогване или съчувствие. Когато хората изпитат силна емоция, са склонни да споделят съдържанието, без да проверят истинността му.

Ехо камери: В социалните мрежи хората са склонни да следват и общуват с други хора, които имат сходни възгледи. Това създава "ехо камери", където фалшивите новини се разпространяват бързо и безкритично, защото "потвърждават" вече съществуващи убеждения.

Липса на дигитална грамотност: Много потребители все още не са запознати с възможностите на AI и не знаят как да разпознават фалшиви изображения. Те приемат това, което виждат, за истина, особено ако се разпространява от техни приятели или от източници, на които вярват. Важи в по-висока степен за хора, които използват дигитални технологии и следят социални мрежи едва с масовото навлизане на смартфоните и нямат опита на познаването на дигиталните изображения в предишните години и елементите, които ги отличават от реални снимки.

Как да разпознаваме AI генерирани изображения?

Въпреки че AI моделите стават все по-добри, все още има някои специфични несъвършенства, по които можем да разпознаем фалшивите изображения.

Аномалии в ръцете и пръстите: Това е един от най-честите провали на AI. Търсете ръце с прекалено много или прекалено малко пръсти, деформирани длани или неестествени пози.

Неестествена симетрия и детайли: Лицата в генерираните изображения често са твърде симетрични, а зъбите и очите изглеждат еднакви. Наблюдавайте за странни текстури, неестествен блясък на кожата или косата, и повтарящи се елементи на заден план.

Нелогични елементи и физически закони: AI моделите понякога не разбират физиката на реалния свят. Потърсете сенки, които не съответстват на източника на светлина, обекти, които не се държат логично, или текст, който е размазан или изписан неправилно.

Дефекти: Понякога може да забележите странни петна, размазване на определени части от изображението или други малки дефекти, които са резултат от процеса на генериране.

Инструменти и техники за проверка

Допълнително търсене на изображение: Един от най-лесните начини е да използвате инструменти като Google Lens или TinEye. Качете изображението и проверете дали вече е било публикувано в друг контекст или от друг източник. Ако не се появи, това може да е знак за генерирано съдържание.

Специализирани AI детектори: Вече съществуват различни онлайн инструменти, които използват AI, за да анализират изображенията и да определят дали са създадени от изкуствен интелект. Те търсят микроскопични аномалии в пикселите и други признаци, които са невидими за човешкото око.

Метаданни: Метаданните на една снимка съдържат информация за камерата, датата и мястото на заснемане. AI генерираните изображения нямат такава информация, което е силен индикатор.

Ограничаване на податливостта

Критично мислене и емоционален контрол: Не се поддавайте на емоциите, които предизвиква дадено изображение. Когато видите нещо, което изглежда твърде невероятно или предизвиква силна реакция (възмущение, страх, съпричастност), спрете и се замислете, преди да го споделите.

Проверка на източника: Кой е публикувал изображението? Известен и надежден източник ли е, или е анонимен профил? Проверете дали същата информация е споделена и от други, достоверни медии.

Медийна грамотност: Запознайте се с основните принципи на работа на AI и с това как то може да се използва за създаване на фалшиво съдържание. Колкото повече знаете за технологията, толкова по-трудно ще бъде да ви заблудят.

Моля, подкрепете ни.